Chez les photographes le débat entre les partisans de la retouche et ceux du développement fait rage depuis l’avènement du numérique.

Où s’arrête la photographie et où commence l’image de synthèse ? Avec l’arrivée de l’IA générative, même les fervents adeptes de Photoshop commencent à poser des limites éthiques.

Il est possible d’effacer des personnages, d’enlever des objets disgracieux, de transformer une journée ensoleillée en matin brumeux, de remplacer un ciel par un autre, d’inventer une partie du cliché, voire de fabriquer de toute pièces un paysage grâce à l’IA générative.

Alors à quel moment une photo n’est plus qu’une image numérique ? Je n’ai pas la réponse à cette question. Personnellement, j’use le moins possible de ces traitements qui substituent une réalité à une autre plus virtuelle. Je n’utilise pas Photoshop mais Lightroom et je n’utilise l’IA que pour réduire le bruit et supprimer de tous petits détails que je n’avais pas noté en réalisant le cliché. Mais ça c’est en photo.

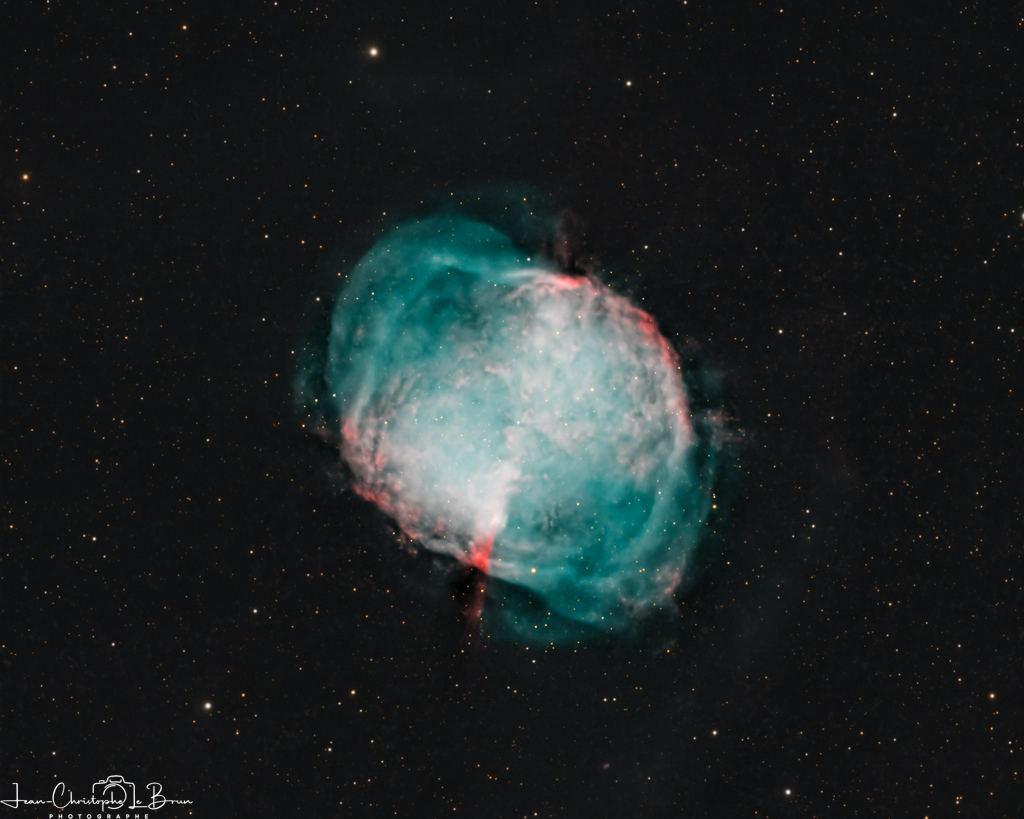

En astro photo, tout est différent. Car qu’est-ce qu’une image en astronomie ? Un signal extrêmement faible, souvent imperceptible par l’œil humain, amplifié par un instrument et une caméra puis délinéarisé dans un logiciel pour transformer des fréquences presque invisibles en couleurs.

Des fréquences invisibles comme l’infrarouge ou l’ultraviolet que les caméras captent et auquel on attribue arbitrairement des couleurs. Lorsque vous regardez une image du télescope Hubble ou James Web, vous ne voyez pas la réalité, vous voyez différentes longueurs d’ondes colorées puis additionnées pour fabriquer une photographie.

Par exemple James Web ne voit que dans l’infrarouge, autant dire que ses couleurs ne reflètent jamais la réalité.

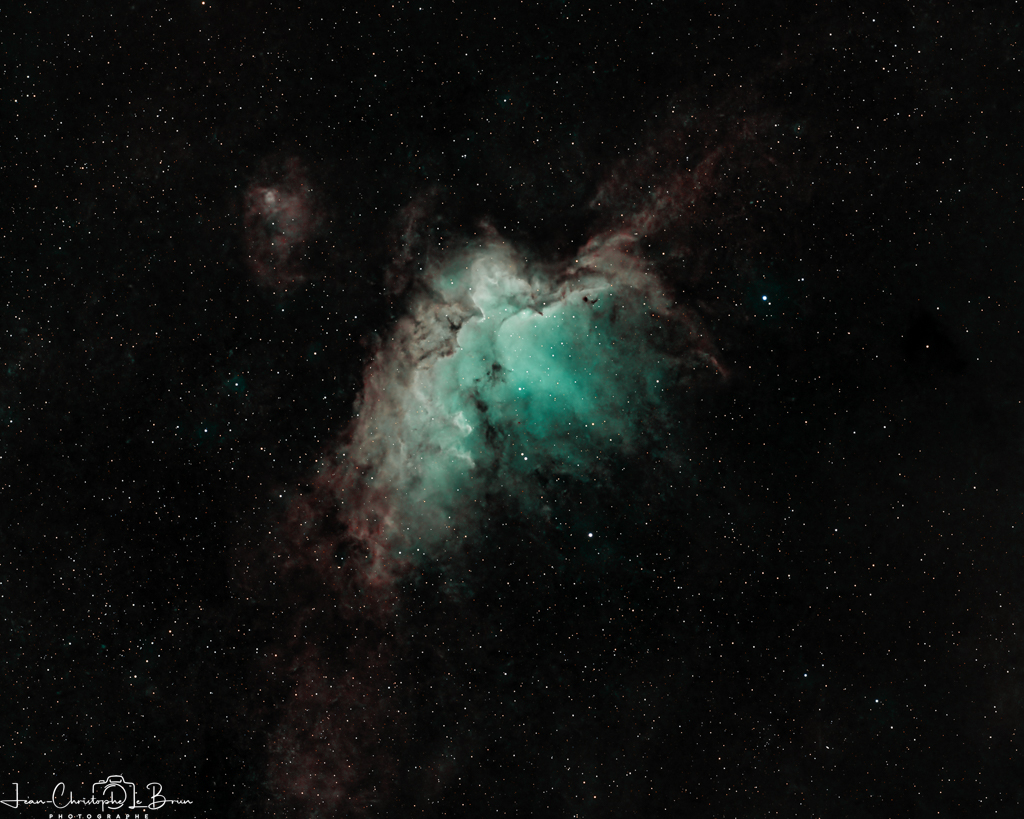

En astronomie, certains utilisent des filtres qui ne laissent passer que certaines longueurs d’ondes ou bloquent certains rayonnements. L’image obtenue est inévitablement biaisée par rapport à la réalité.

J’ai commencé la photographie astro avec un appareil Nikon non défiltré, c’est à dire dont le capteur bloque une partie de l’infrarouge, comme tous les boîtiers photos grand public. Ensuite j’ai utilisé une caméra qui capte tout le spectre, visible et invisible, augmentant considérablement la sensibilité de mon setup. Puis j’ai ajouté un filtre UV/IR Cut pour supprimer les ultraviolets et les infrarouges des éclairages urbains qui polluent les images. Enfin j’ai utilisé un filtre tri bandes qui ne laisse passer que des plages étroites de longueur d’onde, hydrogène, oxygène, souffre. Mes photos ne reflétaient plus vraiment la réalité mais avaient gagné en netteté.

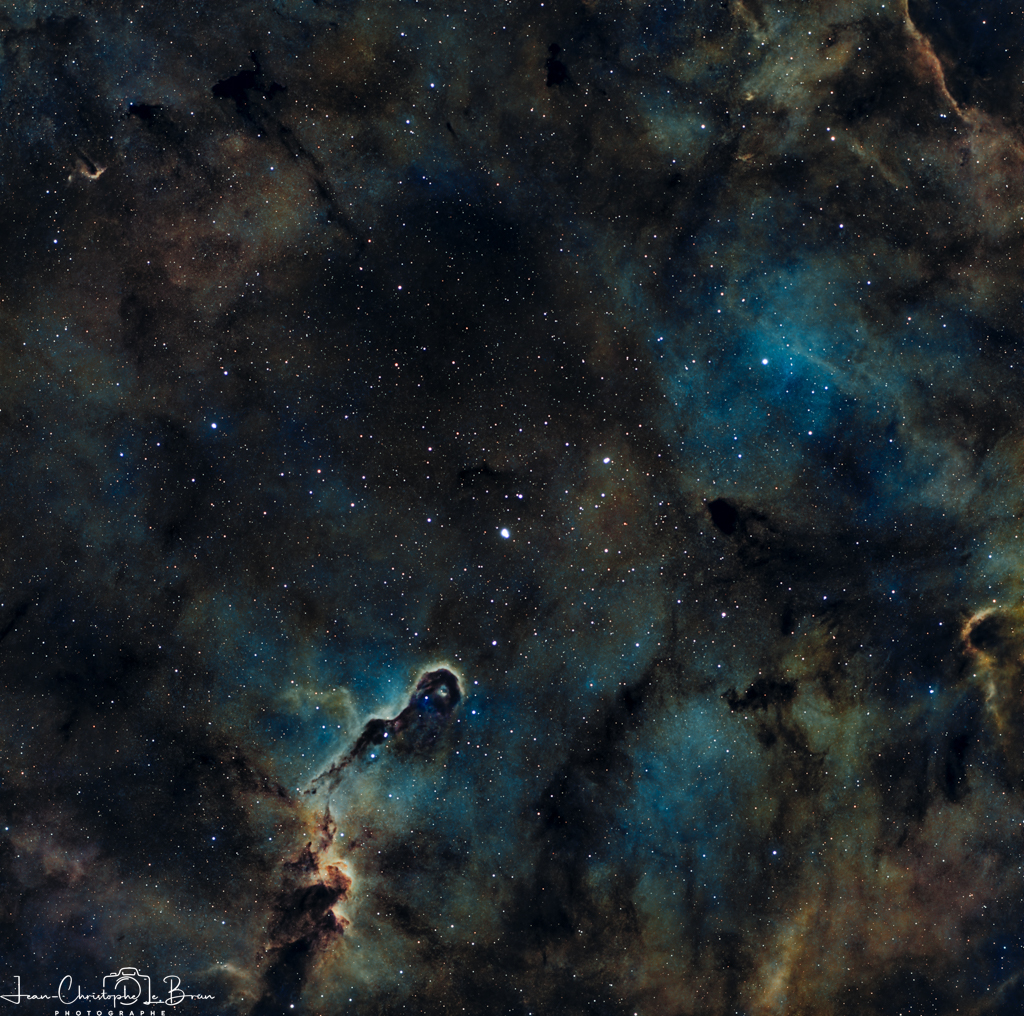

Il y a peu j’ai publié une photo de la nébuleuse de la Trompe d’Eléphant et un de mes mentors m’a conseillé de la traiter en HOO, c’est à dire avec les longueurs d’onde de l’hydrogène et l’oxygène.

Oui mais comment ? Et quel intérêt ? Il m’a envoyé un tutoriel basé sur le logiciel Pixinsight et j’ai essayé. La vidéo dure plus d’une heure et contient plein de concepts qui sont loin d’être évidents. Il m’a fallu deux visionnages avec de multiples arrêts sur images et quelques notes pour comprendre l’idée.

Le principe est d’attribuer une couleur, rouge, vert ou bleu, à une une longueur d’onde particulière. Rouge pour l’hydrogène, vert et bleu pour l’oxygène. Ensuite on isole ces couleurs avec des masques pour les traiter de manière indépendante pour enfin tout assembler pour fabriquer une image.

En réalité c’est un peu plus compliqué. En astro photographie, on va tout d’abord étirer l’histogramme des lumières pour amplifier certaines parties et en atténuer d’autres. On va également séparer les étoiles de l’objet photographié pour les traiter indépendamment. Souvent on choisit de réduire le nombre d’étoiles. On assombrit le fond du ciel pour éviter d’obtenir une voûte céleste grise. Bref on bidouille pendant des heures.

À la fin que reste-il de la réalité ? Nous avons filtré les fréquences, amplifié la lumière, enlevé les étoiles, assombri le ciel, attribué des couleurs arbitraires à certaines fréquences, rehaussé des couleurs, estompé d’autres, supprimé des étoiles, ajouté du contraste, réduit le bruit et fabriqué une photographie avec tous ces éléments additionnés.

Certains astronomes amateurs s’insurgent à raison contre ces pratiques. Car l’information qui pourrait servir à la recherche disparaît lors du traitement de la photographie. Si on n’utilise pas des filtres étalonnés, des caméras spécifiques et des traitements non destructifs, l’image n’est plus exploitable pour la science.

Personnellement, je fais des photographies astro pour la beauté de l’image, pas pour la science. Et le traitement HOO m’offre une toute nouvelle palette de couleurs pour composer des images spectaculaires même si elles sont peu scientifiques.

Un jour je changerais peut-être d’avis, j’utiliserais une caméra monochrome et des filtres étalonnés. Mais pour l’instant, je me fais juste plaisir.